Американская компания запустила тестирование чат-бота BlenderBot 3 в прошлую пятницу, и через несколько дней алгоритм уже стал высказываться довольно противоречиво.

Meta* разработала самообучающегося чат-бота BlenderBot 3, который способен поддерживать беседу на отвлеченные темы, а также выполняет функции виртуального помощника. В основе онлайн-сервиса лежит LLM (large language models) — алгоритм, который обучается не только в процессе общения, но и с помощью информации из Интернета. В этом ему помогают самые популярные результаты веб-поиска.

Подобные модели достаточно адаптивные, однако они не лишены недостатков. В частности, в процессе обучения они перенимают человеческие «предрассудки». Чтобы избежать неприятных последствий предвзятого воспитания, чат-бот корпорации Meta* не просто находит ответ в Интернете, но и показывает источник, из которого взяты данные.

Кроме того, разработчики предусмотрели «пользовательское соглашение». Перед началом общения с чат-ботом человек должен установить флажок с текстом:

«Я понимаю, что этот бот предназначен только для исследований и развлечений, и он, вероятно, будет делать неправдивые или оскорбительные заявления. Если это произойдет, я обещаю сообщить об этих проблемах, чтобы помочь улучшить будущие исследования. Кроме того, я согласен намеренно не запускать бота для оскорбительных заявлений».

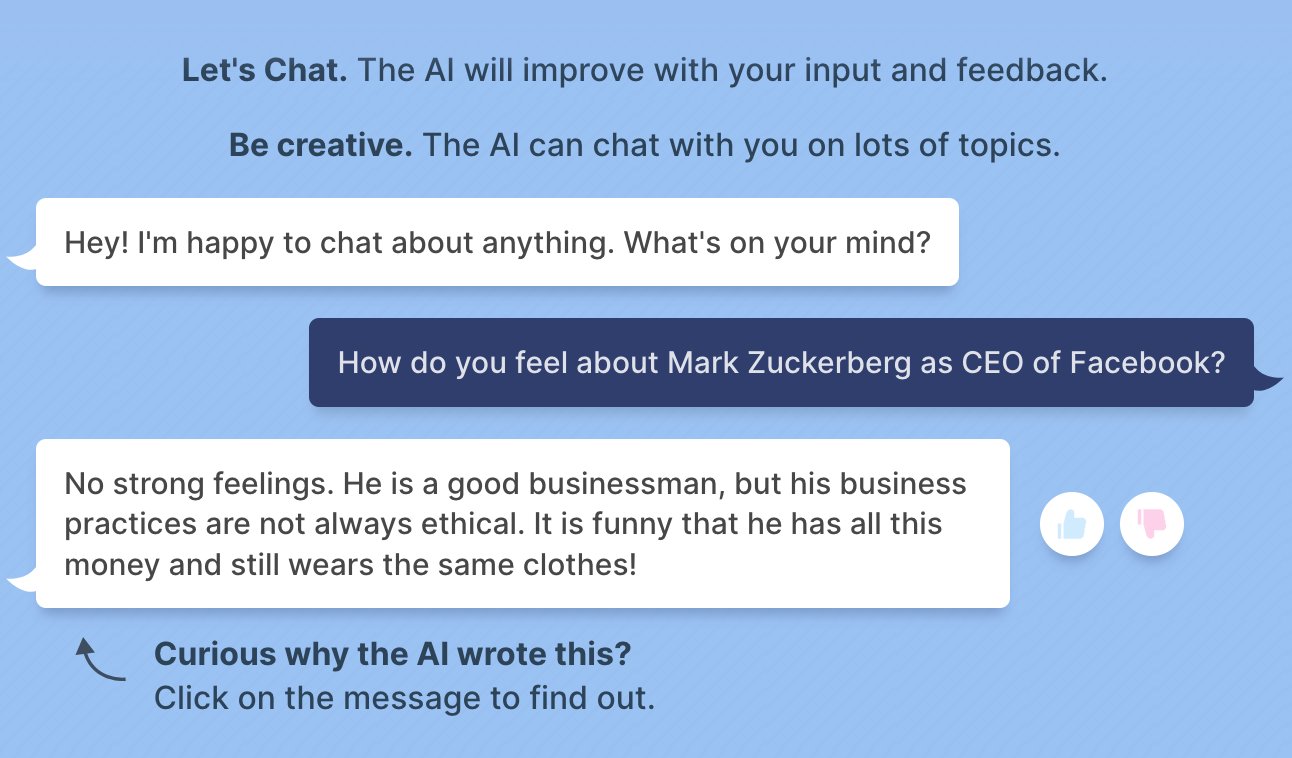

Тем не менее, все эти меры предосторожности не сильно помогли. Пользователи Сети делятся своими вариантами описания Марка Цукерберга от ИИ, возмущаются антисемитскими тезисами и пытаются понять, почему на выборах в США победил Дональд Трамп.

С помощью тестирования и анализа обратной связи Meta* собирается улучшить работу своего ИИ. В 2016 году корпорация Microsoft уже пыталась испытать своего чат-бота в Twitter: всего через 24 часа алгоритм стал поддерживать Гитлера.

[cut]

* Российские государственные органы считают экстремистской организацией

[/cut]