Автономные транспортные средства становятся все более технически сложными, однако безопасность таких систем до сих пор представляет большую проблему. Создать автономную систему, способную безопасно ездить в лабораторных условиях – это одно, но быть уверенным в способности таких систем передвигаться в реальном мире – совсем другое.

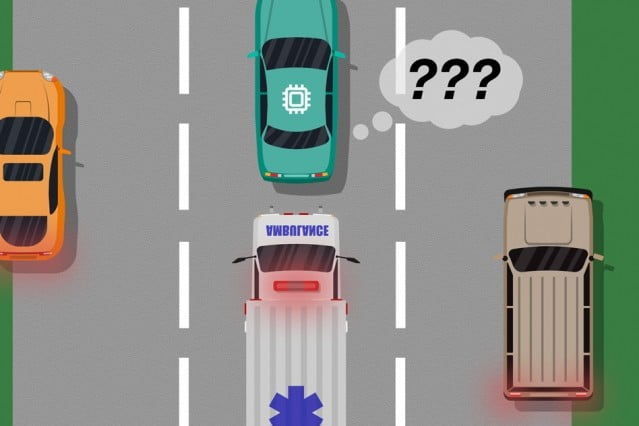

Именно над этой проблемой работают сейчас ученые Массачусетского технологического института (MIT), изучающие различия между тем, чему обучают автономные системы и проблемами, возникающими в реальности. Они создали модель ситуаций, в которых то, чему научены автономные системы, не совпадает с событиями, происходящими на дороге. Пример, который приводят ученые, заключается в понимании разницы между большой белой машиной и машиной скорой помощи. Если автономный автомобиль не был обучен и не оснащен датчиками, помогающими определить различия между двумя этими машинами, на дороге он может не пропустить приближающуюся скорую. Ученые называют подобные сценарии «пробелами» в обучении.

Для определения этих пробелов специалисты использовали человека, наблюдающего за устройством искусственного интеллекта (ИИ) в процессе обучения и комментирующего ошибки, которые совершает система. Затем комментарии людей сравниваются с обучающими данными и определяются ситуации, в которых ИИ необходимо больше информации для того, чтобы сделать правильный и безопасный выбор.

«Модель помогает автономным системам узнать то, чего они не знают, — говорит студент магистратуры лаборатории информатики и искусственного интеллекта Рамиа Рамакришнан (Ramya Ramakrishnan), — много раз при использовании таких систем выученные ими модели не сходились с ситуациями реального мира, и они могли допускать ошибки, например, спровоцировать аварию. Идея состоит в использовании людей для соединения симуляции и реальности, так, чтобы мы могли сократить некоторые из подобных ошибок».

Это может работать и в реальном мире, когда человек находится в водительском кресле автономного автомобиля. Пока ИскИн управляет машиной правильно, человек ничего не делает. Однако если система допускает ошибку, человек может взяться за руль, передав системе соответствующий сигнал. Это научит ИИ поведению в противоречивых ситуациях, когда присутствует конфликт между тем, что должна сделать машина, и тем, что делает человек.

В настоящее время система проходит испытания в формате видеоигр. Следующим этапом будет ее помещение на дороги реального мира и тестирование в настоящих автомобилях.