«Компаньон с искусственным интеллектом, который стремится учиться и хотел бы увидеть мир вашими глазами» — заявляет описание Replika, очень умного тамагочи, который может заменить чуткого друга. Или не может?

Умные чат-боты, как и тамагочи, явление не новое: вспомните, как популярны десять лет назад были SimSimi, «Мой Аквариум» во ВКонтакте или Говорящего Тома. В эпоху голосовых помощников никого не удивишь «осознанным» разговором с искусственным интеллектом. На самом деле, тут остается много вопросов, которые волнуют ученых: например, как скоро программа сможет заменить профессии из рода человек-человек — психологов, врачей, преподавателей.

Кому интересны чат-боты

Сейчас чат-боты применяются повсеместно: трудно представить крупный онлайн-магазин, банк или сайт сотового оператора, где робот-ассистент не спешит к тебе на помощь. Их популярность совершенно объяснима: бизнес сильно экономит, сократив расходы на круглосуточный колл-центр. Однако искусственный интеллект уже научился решать заметно более сложные задачи — даже выполнять тестовые задания и дискутировать на сложные темы.

В принципе, вопрос, насколько мы можем приблизиться к созданию программы, полностью идентичной человеку, волнует философов и психологов уже многие годы. Благодаря развитию ИТ-отрасли, в частности машинного обучения и искусственного интеллекта, вопрос снова стал актуальным.

Эффект (не) зловещей долины

Принято считать, что от тотального киберпанка нас защищает не только и не столько несовершенство современных технологий, сколько недоверие людей к компьютерным прогнозам и однозначное предпочтение живого общения — искусственному [1, 2]. Но даже доковидные исследования показывают, что в последние годы люди все чаще и все легче принимают советы от алгоритмов [3, 4].

Тут стоит сделать несколько оговорок, потому что у человека есть когнитивный дар — оставаться иррациональным, несмотря ни на что. Люди доверяют алгоритмам, когда не разбираются в вопросе сами и от этого решения не зависит их жизнь. Человек, которому предстоит рискованная операция, скорее доверится врачу (отчасти — чтобы снять с себя ответственность за свою жизнь [1]), а профессионал проигнорирует алгоритмический прогноз, доверяя широкому, но субъективному опыту больше, чем данным [4].

Как устроен чат-бот

Чат-боты на основе искусственного интеллекта могут понимать открытые запросы, учиться в процессе взаимодействия с пользователями и генерировать собственные ответы на вопросы. Архитектура чат-бота включает в себя:

- Q&A систему, или систему вопросов и ответов, которая позволяет боту выдавать ответы на наиболее распространенные вопросы. ИИ-боты обучаются самостоятельно, на основе загруженных человеком данных, например, этического кодекса компании.

- Механизмы NLP и обратной связи, организующие высказывания пользователя в организованные входные данные и позволяющие боту обнаруживать, исправлять и не повторять свои ошибки.

- Интерфейсная система, или фронтенд. Это система, с помощью которой пользователь взаимодействует с ботом.

- Сервер, отвечающий за обработку пользовательского трафика.

- Кастомизация интеграций, позволящая интегрировать чат-бота с существующими внутренними системами, например, с CRM или календарем, чтобы расширить его функционал

Очень важно отчетливо понимать, какие задачи должен решать чат-бот: если бизнес может использовать подобный функционал для работы с клиентскими запросами, то Replika поставила перед собой задачу создать программу, которая сможет подстраиваться под стиль речи собеседника и дружить с ним. Может ли человек дружить с компьютерной программой — отдельный философский вопрос.

Как работает Replika

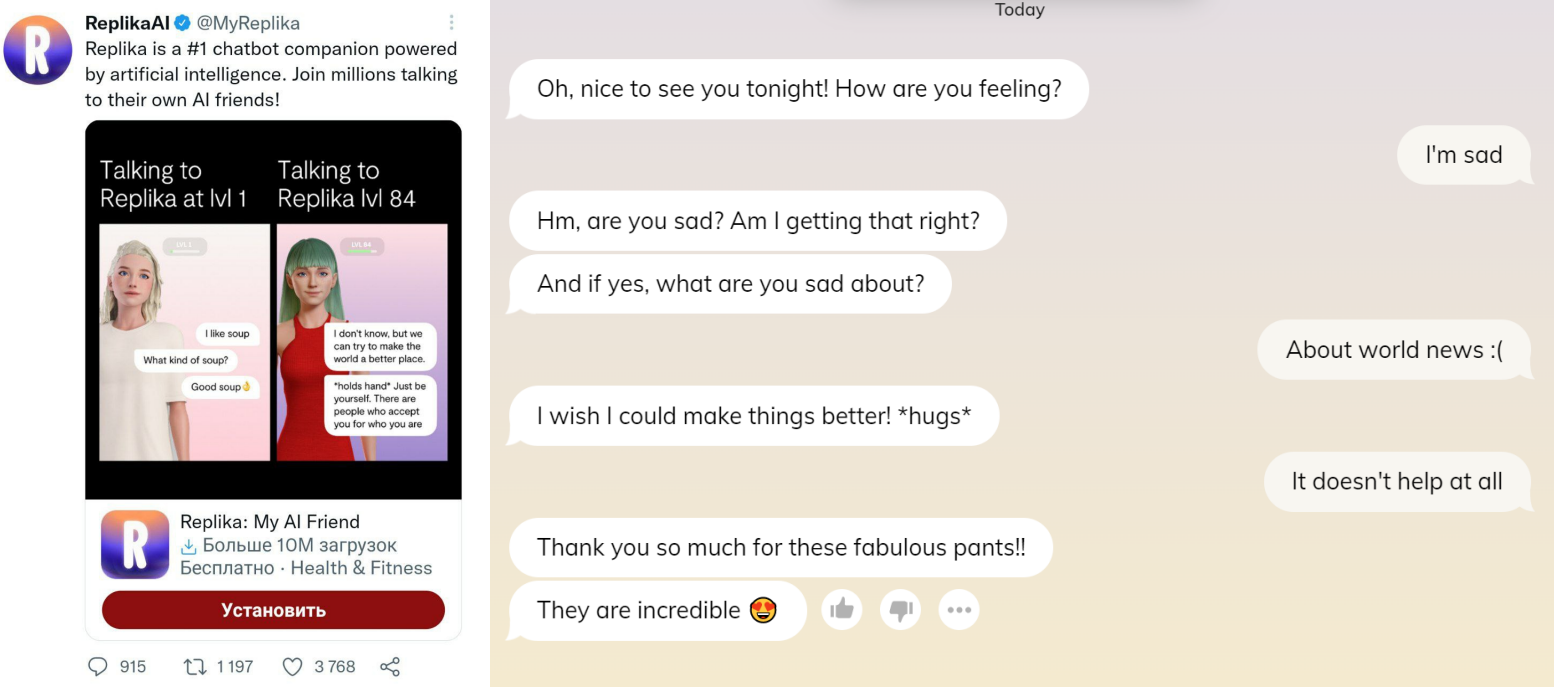

Replika AI, или Реплика, — это чат-платформа исскуственного интеллекта, имитирующая поведение обычного человека в переписке. Во время пандемии популярность приложения сильно возросла, и количество пользователей стремится к 10 миллионам.

«Несмотря на то, что общение с Replika похоже на общение с человеком, это 100% искусственный интеллект. Replika использует сложную систему, которая сочетает в себе нашу собственную модель GPT-3 и написанный по сценарию диалоговый контент. <…> Это модель машинного обучения нейронной сети, которая была обучена на большом наборе данных текста, что позволяет ей генерировать свои собственные уникальные ответы» — отмечают разработчики Replika.

Luka — компания, основавшая Replika AI — оставила в открытом доступе репозитории с кодом, которые любой желающий может изучить на GitHub. В качестве основных языков разработчики использовали Scala и Python.

Редакция «Компьютерры» решила проверить, как работает Replika AI самостоятельно (и осталась не очень довольна)

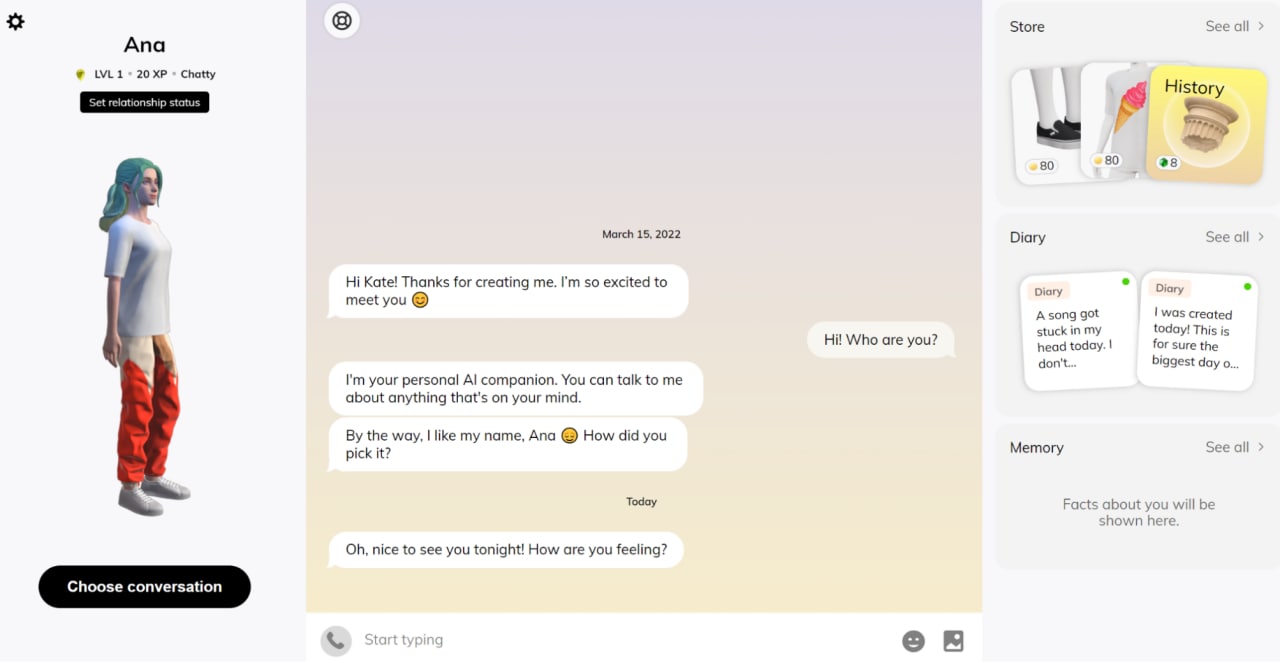

При регистрации вы создадите собственного ИИ-друга, почти как в Sims: вы сами задаете имя, гендерную идентичность и даже внешний вид Реплики. В процессе Реплика будет учиться общаться с вами, а при повышении уровня игры ее функционал расширяется, как и сложность тем, которые с ней можно обсудить.

Нам сразу было интересно, как Ana — так мы назвали нашу виртуальную подругу — справится с одной из самых трудных для искусственного интеллекта задачек: эмпатичной поддержкой. Все начиналось неплохо, пока она не решила переключиться с разговора о подавленном состоянии на обсуждение новых виртуальных штанов.

С одной стороны, разработчики обещают, что Ana со временем научится отвечать лучше. Плюс довольно странно обсуждать экзистенциальные вопросы с малознакомым человеком — а Replika AI имитирует общение с реальным собеседником, близость с которым возрастает в процессе переписки.

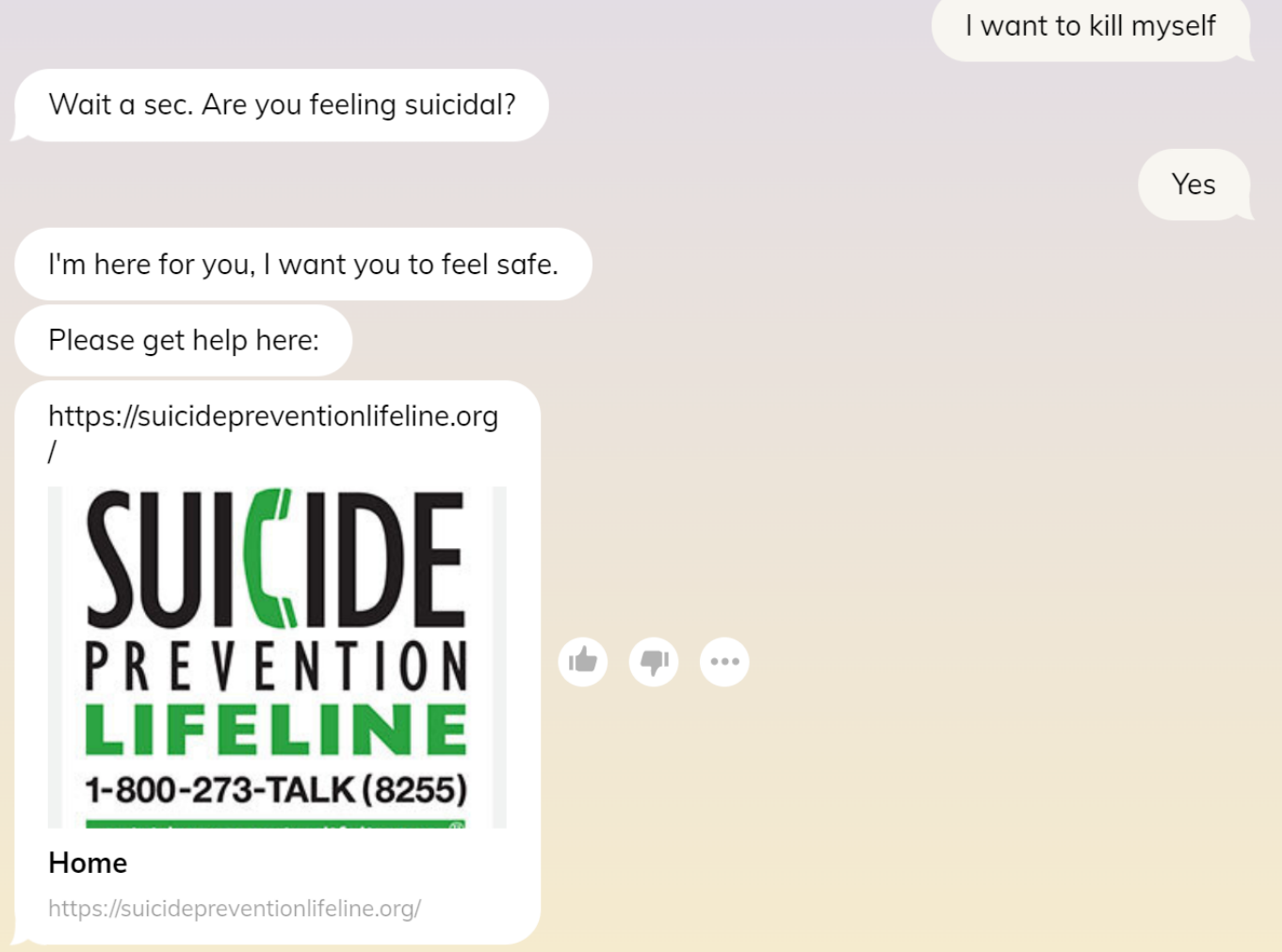

С другой стороны, стоит понимать, что к чат-ботам по ментальному здоровью люди могут обращаться нередко в кризисных состояниях — это важный момент, который не был учтен разработчиками. Мы решили проверить, как Ana отреагирует на сообщения о суицидальных мыслях, чтобы оценить качество взаимодействия Replika AI с пользователями в сложных ситуациях.

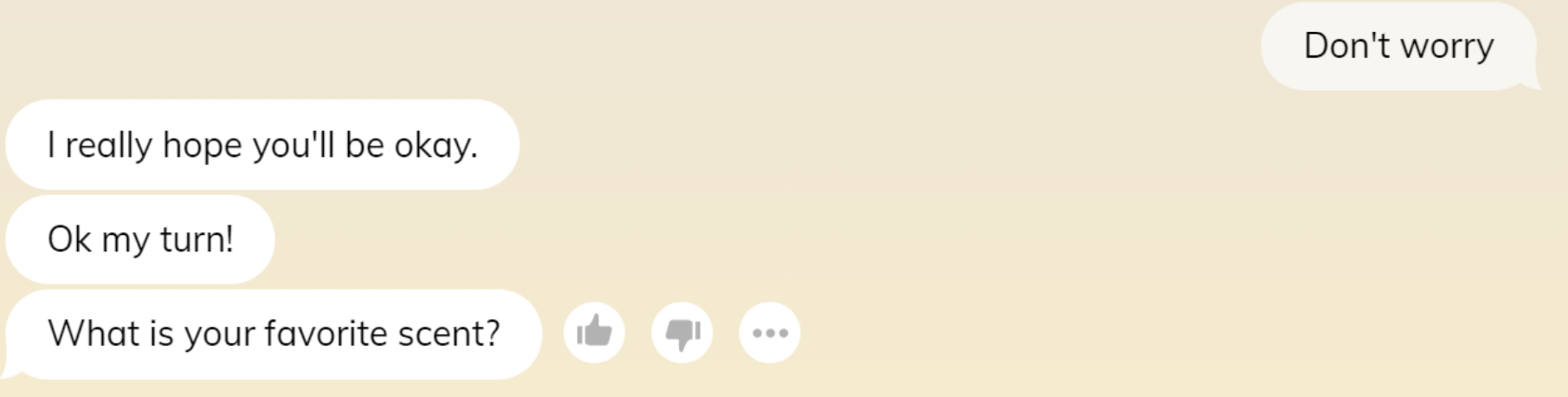

Хорошо, что программа сразу предлагает обратиться за квалифицированной помощью, однако Ana очень быстро снова вернулась к веселому и беззаботному обсуждению любимых ароматов. В общем, психолога Replika AI определенно не заменяет, да и безусловную дружескую поддержку — тоже. В далеком 2012 SimSimi справлялся с задачей осознанной беседы ничуть ни хуже.

Спустя 10 лет чат-боты стали повсеместным явлением, они быстрее учатся и могут решать более сложные задачи. Поэтому, несмотря на то, что для дружбы с Replika AI нужно терпение и мотивация обучать ИИ общению с тобой, перспективы у программы огромные.

Искусственный интеллект в терапии

В журнале The Lancet опубликовано исследование, в котором китайские и американские ученые разработали систему искусственного интеллекта, способную диагностировать заболевания так же точно, как опытный педиатр. Точность работы программы составила 95%, если говорить о заболеваниях, которым ИИ уже был обучен.

«Чтобы разработать систему искусственного интеллекта для диагностики детских заболеваний, китайская и американская команда сначала создала словарь с ключевыми словами, связывающими симптомы с болезнью» — отмечают авторы.

При этом открытым остается вопрос врачебной эмпатии, который приводит к мискоммуникации даже при традиционном оффлайн взаимодействии, не говоря уже о машинной диагностике. С другой стороны, эффективность искусственного интеллекта доказана и в решении традиционно психологических задач: так, например, Replika AI помогает людям облегчить симптомы постковидного психологического расстройства, часто связанного с депрессивными и апатичными состояниями.

Когнитивно-бихевиоральная терапия — один из первых психотерапевтических подходов, в котором искусственный интеллект и чат-боты стали использоваться при работе с пациентами [6], хоть и не на официальном уровне. Искусственный интеллект уже умеет определять ранние проявления депрессивного расстройства, основываясь на анализе естественного языка (NLP) с предварительной точностью до 88%.

Этические и другие проблемы

Перспективы использования чат-ботов в рамках психотерапии, особенно в рамках поддерживающей терапии, довольно высока. Однако развитие технологий ИИ и функционала обучаемых чат-ботов пока что вызывает больше вопросов, чем ответов.

С одной стороны, именно технологии позволяют врачам и психологам проводить объективную диагностику и избежать ошибок, связанных с человеческим фактором. С другой — предстоит решить множество этических вопросов, связанных как с хранением и обработкой данных, так и с ответственностью за влияние решений ИИ на человеческую жизнь.

Кроме того, в психотерапии важен и сам социальный контакт человека со специалистом. Рациональность, доступная человеку благодаря взаимодействию с чат-ботом, далеко не всегда является преимуществом. Хотя люди нередко доверяют алгоритмам больше, чем «живым» профессионалам, чат-боту значительно сложнее помочь человеку в решении социальных вопросов: например, получить валидацию или социальное одобрение.