Вчера прошел DevDay от OpenAI, где компания представила новые дополнения и улучшения, а также поделилась новостью о снижении цен на компоненты ее платформы. К ним относятся: GPT-4 Turbo с контекстом 128K и более низкими ценами, новый Assistants API, GPT-4 Turbo с Vision, DALL-E 3 API и многое другое.

Генеральный директор OpenAI Сэм Альтман объявил, что с инструментами OpenAI работают 2 миллиона разработчиков и около 460 компаний из списка Fortune 500. Еженедельно ChatGPT используют более 100 миллионов человек.

Иногда кажется, что ChatGPT всегда был с нами. А ведь он вышел всего год назад, в конце ноября 2022 года. Не прошло и года с релиза ChatGPT, а новинки из лабораторий OpenAI не перестают выходить в свет. Трудно сказать, кто еще из корпораций может похвастаться такими результатами.

GPT-4 Turbo с контекстом 128K

В марте OpenAI выпустила первую версию GPT-4, а в июле сделали GPT-4 общедоступным для всех разработчиков. На презентации DevDay компания представила предварительную версию следующего поколения этой модели — GPT-4 Turbo.

- Расширен контекст до 128K токенов, то есть в одном запросе может поместиться текст, эквивалентный более чем 300 страницам.

- База знаний ChatGPT-4 Turbo включает информацию до апреля 2023 (для сравнения, у GPT-4 было до сентября 2021).

- Фича для разработчиков: можно заставить модель писать ответы в JSON-формате.

- Можно вызывать несколько функций за раз в одном сообщении, то есть пользователи могут отправить одно сообщение с запросом на несколько действий, что ранее требовало нескольких обращений к модели.

- Возможна загрузка документов, в том числе в формате PDF.

- Модель более аккуратна при работе с длинным текстом, не теряет то, что было в середине.

- Модель лучше следует инструкциям. GPT-4 Turbo лучше, чем предыдущие модели, справляется с задачами, которые требуют тщательного выполнения инструкций.

- Можно указать seed генерации, чтобы получать воспроизводимость. Новый параметр seed позволяет получить воспроизводимые результаты, заставляя модель возвращать последовательные завершения большую часть времени. Эта бета-версия функции полезна для таких случаев, как воспроизведение запросов для отладки, написание более полных модульных тестов и в целом получение более высокой степени контроля над поведением модели.

- Скоро добавят logprobs в API. Компания обещает запустить функцию возврата лог-вероятностей для наиболее вероятных лексем, генерируемых GPT-4 Turbo и GPT-3.5 Turbo. Это полезно для создания таких функций, как автозаполнение в поиске.

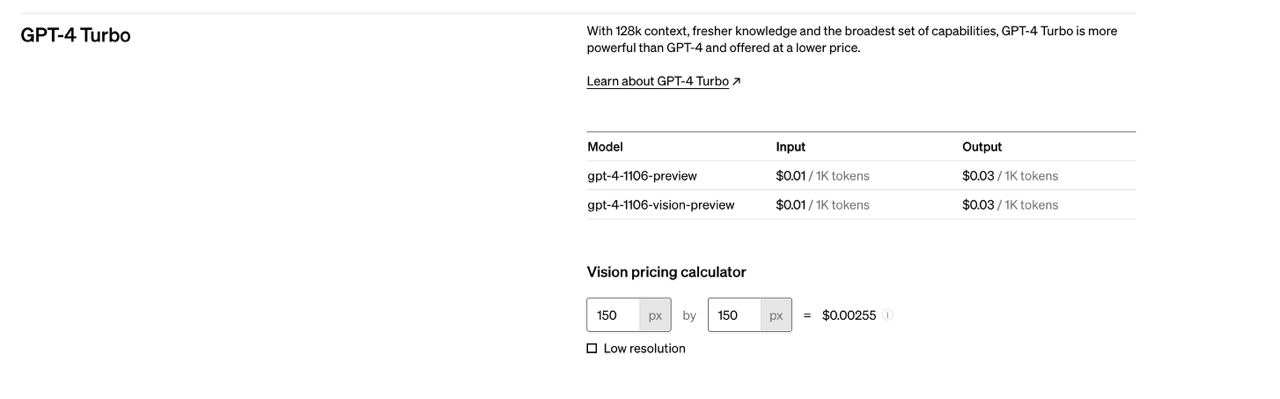

Каждый токен в промте стал в 3 раза дешевле, а сгенерированные токены — в 2 раза дешевле по сравнению с GPT-4. Обновили страницу прайсинга, плюс есть попиксельный калькулятор цены вызова API с картинкой.

Обновленный GPT-3.5 Turbo

В дополнение к GPT-4 Turbo вышла новая версия GPT-3.5 Turbo, которая по умолчанию поддерживает контекстное окно размером 16 Кбайт. Новая версия 3.5 Turbo поддерживает улучшенное следование инструкций, режим JSON и параллельный вызов функций.

Разработчики могут получить доступ к этой модели, вызвав в API команду gpt-3.5-turbo-1106. Приложения, использующие gpt-3.5-turbo, будут автоматически обновлены до новой модели 11 декабря. Доступ к более старым моделям можно будет получить, передав в API команду gpt-3.5-turbo-0613 до 13 июня 2024 года.

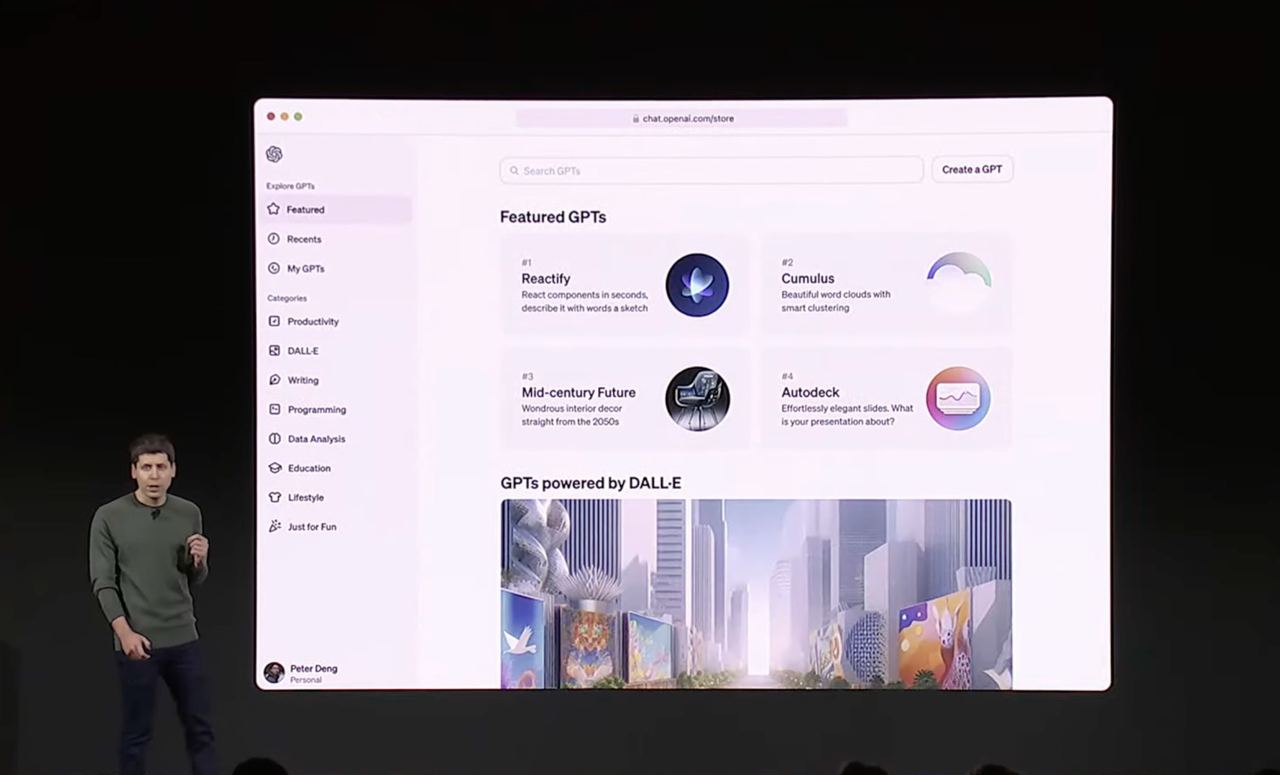

GPTs: кастомизированные ИИ-ассистенты

На конференции анонсировали GPTs — возможность создания кастомных версий ChagGPT для разных целей.

Разработали новый дизайн и переработали UI, добавив возможность создавать отдельных чатботов. Он состоит из промпта, нескольких вспомогательных файлов, на которые бот может опираться, и набора функций/инструментов. Помимо стандартных DALLE-3 и интерпретатора кода, можно свободно добавлять любые произвольные function calls к внешним сервисам. Дальше ботом можно поделиться и таким образом предоставить доступ определенному сценарию. Например, чатбот для записи в клиники или шиномонтаж, Q&A бот и так далее.

А еще в конце месяца выйдет GPT-Store, где можно будет после модерации разместить свою модель, то есть разработчики могут продавать свои кастомизированные GPT на централизованном маркетплейсе. Авторы будут получать оплату в зависимости от использования их GPT.

Assistants API

Выпустили Assistants API — набор no-code инструментов для создания кастомных ботов-ассистентов на основе ChatGPT. В OpenAI считают, что это «первый шаг к тому, чтобы помочь разработчикам создавать агентов в своих приложениях».

Ассистент — это специально созданный ИИ, который имеет конкретные инструкции, использует дополнительные знания и может вызывать модели и инструменты для выполнения задач. Ассистенты могут писать и выполнять код, принимать на вход документы и PDF. Возможность грузить картинки добавят позже.

Ассистенты берут на себя большую часть работы, которую раньше приходилось делать самостоятельно, и они помогают создавать высококачественные приложения с искусственным интеллектом.

Этот API разработан для гибкого использования: это и приложение для анализа данных на естественном языке, и помощник по кодированию, и планировщик отпусков на базе ИИ, и диджей с голосовым управлением — список можно продолжать. API Assistants построен на тех же возможностях, что и новый продукт GPTs:

- Code Interpreter: пишет и выполняет код на языке Python в изолированной среде выполнения, может генерировать графики и диаграммы, обрабатывать файлы с различными данными и форматированием;

- Retrieval: дополняет ассистента знаниями, полученными из внешних моделей, например, собственными данными о доменах, информацией о продуктах или документами, предоставленными пользователями;

- Function calling: позволяет ассистентам вызывать определенные функции и включать ответ функции в свои сообщения.

Данные и файлы, переданные в OpenAI API, никогда не используются для обучения моделей, и разработчики могут удалять их по своему усмотрению. API Assistants находится в бета-версии и доступен для всех разработчиков с сегодняшнего дня. Попробовать бета-версию можно тут.

Новые модальности (Vision & Audio)

ChatGPT теперь может принимать картинки через API

GPT-4 Turbo может принимать изображения в качестве входных данных в API Chat Completions, что позволяет реализовать такие сценарии использования, как генерация подписей, детальный анализ изображений реального мира и чтение документов с рисунками. Например, BeMyEyes использует эту технологию для помощи слепым или слабовидящим людям в решении повседневных задач: идентификация товара или навигация по магазину. Разработчики могут получить доступ к этой функции, используя gpt-4-vision-preview в API.

Dalle-3 теперь доступна через API

Разработчики могут интегрировать DALL-E 3, который недавно запустили для пользователей ChatGPT Plus и Enterprise, непосредственно в свои приложения и продукты через API Images. Такие компании, как Snap, Coca-Cola и Shutterstock, используют DALL-E 3 для программной генерации изображений и дизайна для своих клиентов и кампаний. Как и в предыдущей версии DALL-E, в API встроена функция модерации, которая помогает разработчикам защитить свои приложения от неправомерного использования.

Передача текста в речь (TTS)

Разработчики теперь могут генерировать человеческую речь из текста с помощью API преобразования текста в речь. У ElevenLabs появился серьезный конкурент. Создатели ChatGPT выкатили ИИ-синтезатор голоса. Нейросеть берет ваш текст и зачитывает его естественным тембром с реалистичной интонацией. Генерация крайне быстрая, на выбор представлено несколько голосов. Попробовать можно тут. Цены начинаются от 0,015 долл. за ввод 1 000 символов.

Whisper v3 и Consistency Decoder

Выпускают еще одну новую SOTA модель для распознавания речи Whisper large-v3. В ней будет еще больше языков. Она отличается повышенной производительностью на всех языках. В планах — обеспечить поддержку Whisper v3 в API.

Также открывают доступ к декодеру Consistency Decoder, который представляет собой замену декодера Stable Diffusion VAE. Он улучшает все изображения, совместимые с VAE Stable Diffusion 1.0+, значительно улучшая текст, лица и прямые линии.

Кастомизация моделей

Экспериментальный доступ к доработке GPT -4

Создана программа экспериментального доступа для тонкой настройки GPT-4. Предварительные результаты показывают, что тонкая настройка GPT-4 требует больше работы для достижения значимых улучшений. По мере повышения качества и безопасности тонкой настройки GPT-4 разработчикам предоставят возможность перейти на программу GPT-4 в своей консоли тонкой настройки.

Пользовательские модели: программа b2b-дообучения моделей под задачу заказчика

Некоторым организациям требуется еще больше кастомизации, чем при тонкой настройке. Особенно это касается областей с очень большими собственными наборами данных — как минимум, миллиарды токенов.

OpenAI запускает программу Custom Models, предоставляющую отдельным организациям возможность работать со специальной группой исследователей OpenAI для обучения GPT-4 под их конкретную область. Это включает в себя модификацию каждого этапа процесса обучения модели, начиная от дополнительной предварительной подготовки, специфичной для конкретного домена, и заканчивая запуском индивидуального процесса пост-обучения RL, адаптированного для конкретного домена. Организации будут иметь эксклюзивный доступ к своим моделям.

В соответствии с существующей политикой конфиденциальности пользовательские модели не будут передавать другим клиентам или использовать для обучения других моделей. Собственные данные, предоставленные OpenAI для обучения пользовательских моделей, также не будут повторно использоваться в каком-либо другом контексте.

Более низкие цены

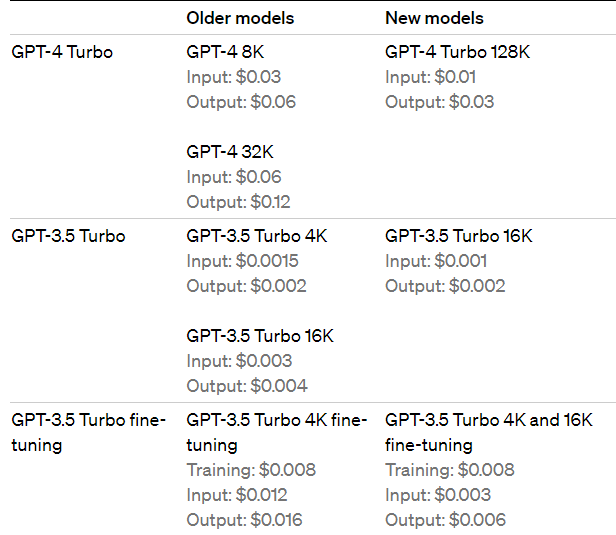

OpenAI снижает цены по всей платформе (все цены ниже указаны за 1 000 токенов).

- Входные токены GPT-4 Turbo в 3 раза дешевле, чем GPT-4 по цене 0,01 долл., а выходные токены в 2 раза дешевле по цене 0,03 долл.

- Входные токены GPT-3.5 Turbo в 3 раза дешевле предыдущей модели 16K — 0,001 долл., выходные токены в 2 раза дешевле — 0,002 долл. Разработчики, ранее использовавшие GPT-3.5 Turbo 4K, получают 33%-е снижение цен на входные токены по цене 0,001 долл. Эти более низкие цены распространяются только на новый GPT-3.5 Turbo.

- Входные токены модели GPT-3.5 Turbo 4K с тонкой настройкой снижены в 4 раза и составляют 0,003 долл., а выходные токены дешевле в 2,7 раза и составляют 0,006 долл. Тонкая настройка также поддерживает 16K контекст по той же цене, что и 4K в новой модели GPT-3.5 Turbo. Новые цены распространяются и на модели с тонкой настройкой gpt-3.5-turbo-0613.

Кроме того, есть и другое нововведение — более высокие лимиты скорости. Чтобы помочь масштабировать свои приложения, OpenAI удваивает лимит токенов в минуту для всех клиентов GPT-4.

Защита авторских прав

OpenAI стремится защитить своих клиентов с помощью встроенных средств защиты авторских прав. Теперь они вводят Copyright Shield, то есть будут защищать клиентов и оплачивать понесенные расходы, если те столкнутся с судебными исками о нарушении авторских прав. Это касается общедоступных функций ChatGPT Enterprise и платформы для разработчиков.

Простыми словами, если вы столкнулись с проблемами из-за генерации контента продуктами OpenAI, то вы как клиент ничем не рискуете, а компания вступится за вас и оплатит штраф при необходимости. Кстати, с такой же инициативой недавно выступила Microsoft применительно к Copilot.