В одном из эпизодов сериала «Черное зеркало» главный герой живет в обществе, где каждый социальный контакт оценивается рейтингом. От этих цифровых баллов зависит буквально все — карьера и отношения. Иллюзия идеального «я» управляется алгоритмами. И хотя это выглядит как антиутопия, сегодня технологии искусственного интеллекта (ИИ) уже вторгаются в повседневность. Не передают ли люди машинам самое главное — право решать, кому доверять?

Аутсорсинг доверия может стать следующим крупным трендом в развитии ИИ — об этом расскажем в статье.

От EDITH к Cluely: ИИ как новая реальность

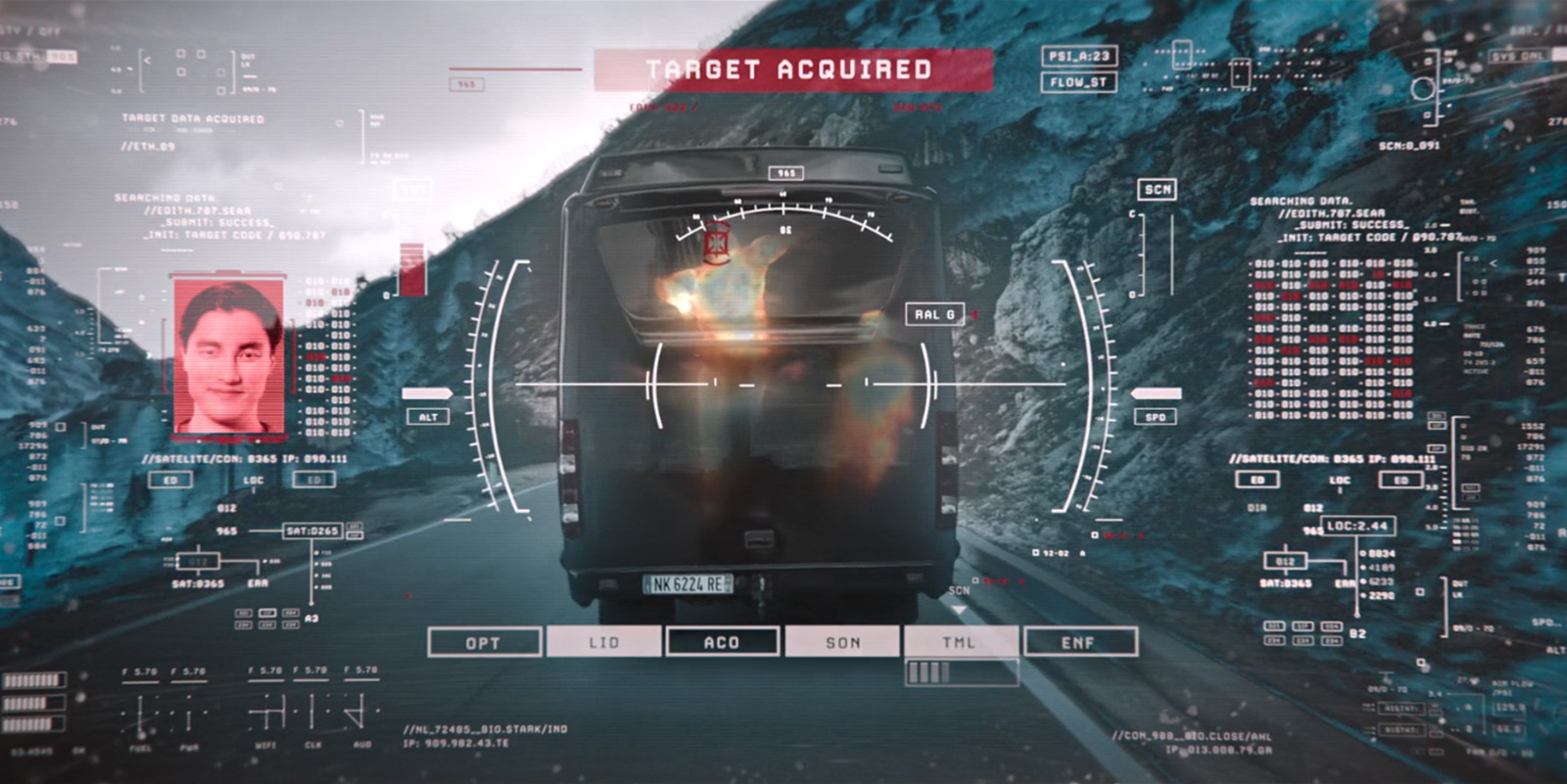

«Даже мертвый, я остаюсь героем…» — эта реплика Тони Старка, прозвучавшая в фильме «Человек-паук: Вдали от дома», отсылает к EDITH — системе ИИ, разработанной в киновселенной Marvel. EDITH предоставляет своему новому владельцу, Питеру Паркеру, доступ к спутниковым сетям, системам наблюдения и управлению дронами. Простое голосовое указание превращается в команду с потенциально фатальными последствиями. Образ ИИ как могущественного и всеведущего ассистента — уже не вымысел, а отражение реальных технологических тенденций.

В эпизоде «Нырок» сериала «Черное зеркало» общество превращено в театр тотальной вежливости. Каждый человек оценивает другого в реальном времени, и социальный рейтинг становится валютой — от которой зависит право снимать жилье, брать ипотеку или просто попасть на рейс.

Сегодняшние цифровые экосистемы все чаще расставляют приоритеты: кого показать в рекомендациях, с кем «свести» в поиске работы, кого пригласить на собеседование или кому доверить кредит. За этими решениями — холодный математический расчет, упакованный в дружелюбный интерфейс.

Социальные баллы в Китае, скрытые скоринг-системы в HR, рейтинги водителей, пассажиров и продавцов, алгоритмическая модерация на платформах — человечество уже живет внутри сети оценок. Причем люди часто не знают, по каким критериям их судят. Машины не объясняют логику, а просто сообщают результат: «вы не прошли», «вам отказано», «вы вне выборки».

Так, сценарий, ранее существовавший только в рамках художественной фантастики, получает практическое воплощение в виде новых решений на стыке ИИ и пользовательского интерфейса.

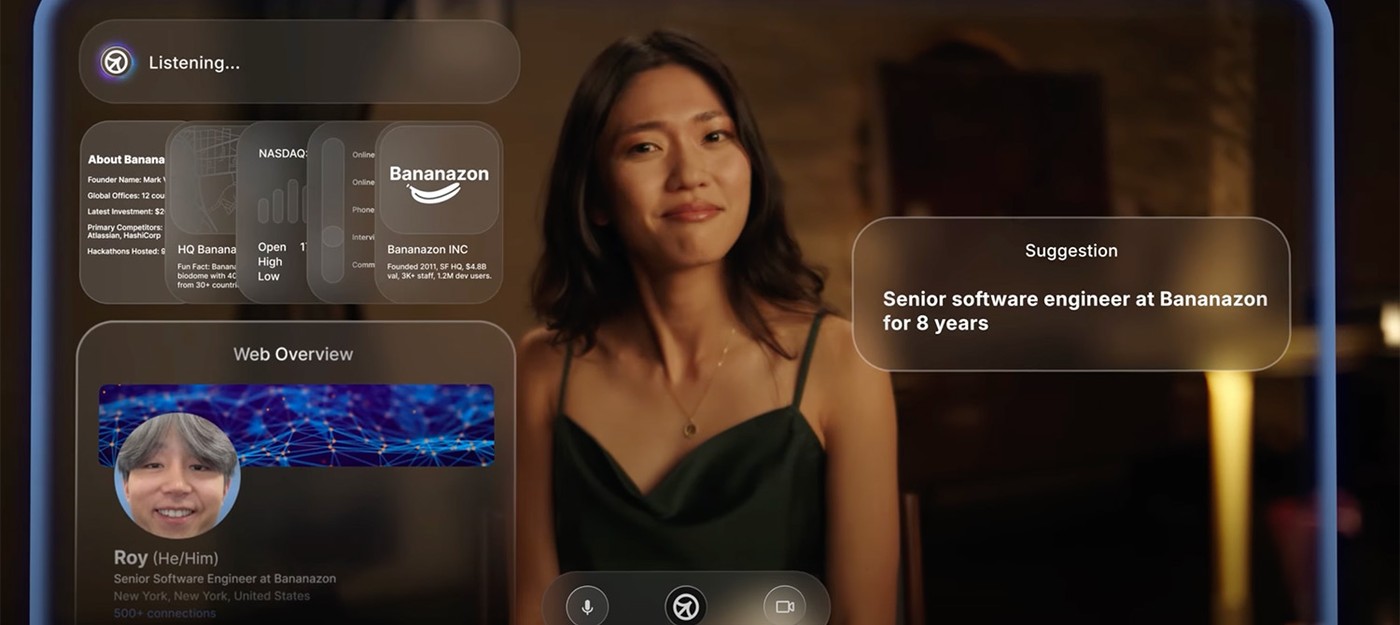

Один из примеров — стартап Cluely AI, разработанный как система поддержки принятия решений в режиме реального времени. Продукт позиционируется как «цифровой компаньон», предоставляющий подсказки и рекомендации в различных социальных контекстах — от прохождения собеседований до ведения переговоров и неформального общения.

Иными словами, функции, ранее приписываемые супергеройским технологиям, начинают интегрироваться в повседневную жизнь, трансформируя как способы коммуникации, так и саму структуру человеческого взаимодействия.

ИИ как инструмент социальной компенсации

История Cluely началась с эпизода академического нарушения. Тогда еще студент Колумбийского университета Чунгин «Рой» Ли разработал Interview Coder — программу, которая в реальном времени подсказывала ответы на технические вопросы во время собеседований. Проект привел к его отчислению за нарушение принципов академической честности. Однако Ли не отказался от своей идеи, а трансформировал ее в более универсальный продукт — Cluely AI, позиционируемый как персональный ИИ-компаньон для повседневных коммуникаций.

Cluely работает в виде браузерного оверлея. Он предоставляет подсказки в реальном времени: помогает формулировать ответы, корректирует стиль общения, подсказывает интонацию и эмоциональный тон. Это пример модели confidence-as-a-service — уверенность как технологически предоставляемая услуга, превращающая спонтанные социальные ситуации в управляемые сценарии.

Этика или эффективность: где проходит граница?

Разработчики Cluely позиционируют продукт как нейтральный инструмент — аналог калькулятора, но для повседневного взаимодействия. По их утверждению, ИИ лишь помогает пользователю структурировать речь и уверенно действовать в сложных социальных ситуациях. Однако критики все чаще поднимают вопрос: где проходит грань между технологическим ассистентом и инструментом, подменяющим личность?

Согласно отчету McKinsey Global Survey on AI, более 60% руководителей компаний обеспокоены ростом зависимости сотрудников от ИИ в сценариях, требующих критического мышления и автономного принятия решений. Особенно это актуально для ролей, связанных с межличностным взаимодействием — менеджмента, продаж, клиентского сервиса и рекрутинга.

Наиболее показательный пример этических противоречий — вирусное видео с участием основателя Cluely, в котором он использует продукт во время романтического свидания. В ролике ИИ в реальном времени предоставляет информацию о собеседнице, формулирует ответы и корректирует поведение. Сцена вызывает тревожные ассоциации: пользователь не общается, а исполняет сценарий, подготовленный цифровым интерфейсом.

Согласно исследованию Pew Research (2023), 72% респондентов выражают обеспокоенность тем, что использование ИИ снижает подлинность межличностного взаимодействия — особенно в профессиональных и личных контекстах.

Как отмечает MIT Technology Review, подобные приложения постепенно стирают различие между «естественным» и «опосредованным» общением, поднимая важные вопросы о подлинности, согласии и манипуляции в цифровой среде.

Критики указывают, что в отличие от инструментов поддержки (например, навигации или проверки орфографии), Cluely вмешивается в эмоционально и этически значимые сферы — личные отношения и деловые переговоры. Это поднимает фундаментальный вопрос: могут ли люди считать взаимодействие подлинным, если значительную часть коммуникации производит алгоритм?

Академическая честность: новый взгляд

Cluely AI стал не только предметом обсуждения в контексте личных и профессиональных коммуникаций, но и спровоцировал серьезные дискуссии в образовательной сфере. Технология, позволяющая студентам получать подсказки в реальном времени во время экзаменов и собеседований, поднимает вопрос: каковы границы допустимого использования ИИ в обучении?

По данным исследования Inside Higher Ed, 43% студентов в США признались, что регулярно используют ИИ в учебной деятельности. При этом треть опрошенных указала, что прибегает к ИИ в ситуациях, требующих самостоятельного выполнения заданий, включая тесты и экзамены.

Одновременно с этим, как отмечает The New York Times, преподаватели тоже все чаще используют ИИ-решения — от генерации заданий до автоматизированной оценки письменных работ. Это приводит к постепенному размытию границ между обучением как процессом формирования навыков и автоматизированной обработкой учебной информации.

Эксперты, включая представителей Ethics & Education Network, подчеркивают, что ситуация требует не только обновления регламентов академической честности, но и глубокого переосмысления самих принципов обучения в условиях технологической интеграции. Если и студенты, и преподаватели полагаются на ИИ как на интеллектуальный «протез», возникает вопрос: какие формы усилия и компетенции по-прежнему считать значимыми?

К чему приводит зависимость от ИИ

Привлекательность инструментов, подобных Cluely AI, очевидна: они снижают неуверенность, минимизируют социальные риски и создают иллюзию контроля. Но если люди постоянно полагаются на подсказки, остается ли в них что-то подлинное?

Данные показывают, что чрезмерная зависимость от ИИ может подрывать уверенность в собственных способностях. Например, исследование, опубликованное в Nature, выявило, что 27,7% студентов в Пакистане и Китае испытывают снижение способности к принятию решений из-за использования ИИ, а 68,9% отмечают рост лени в результате такой зависимости.

Кроме того, чрезмерное использование ИИ может привести к снижению самооценки. Как отмечается в статье на Medium, постоянное обращение к ИИ для выполнения задач, ранее выполнявшихся человеком, может подорвать уверенность в собственных способностях и способствовать чувству беспомощности.

Сила в том, чтобы справляться с собственными ограничениями

В популярной культуре Marvel неоднократно подчеркивалось, что сила — это не все. Настоящее испытание заключается в способности справляться с собственными ограничениями. Питер Паркер должен был снимать очки EDITH, чтобы принимать решения самостоятельно. В реальной жизни нам также необходимо сохранять автономию и критическое мышление, несмотря на привлекательность ИИ-подсказок.

Инструменты вроде Cluely создают новый тип посредничества между людьми — когда реальное восприятие заменяется цифровыми алгоритмами. Это приводит к тому, что граница между естественным общением и управляемым сценарием становится все более размытой.

В такой ситуации вопрос доверия приобретает особую актуальность: если люди перестают доверять друг другу и доверяют ИИ, кто на самом деле управляет решениями и действиями? Зависимость ставит под сомнение развитие личной ответственности и способность к самостоятельному мышлению.

Важно понимать, что технология сама по себе не является ни положительной, ни отрицательной — все зависит от того, как люди интегрируют в свою жизнь. Без четких этических ориентиров и культурных норм, которые учитывают новые вызовы, ИИ рискует превратиться из инструмента поддержки в инструмент контроля и подмены человеческих отношений.

Поэтому следующий этап развития ИИ — не только совершенствование алгоритмов, но и формирование нового социального контракта, который позволит сохранить свободу, личную идентичность и настоящую взаимность в мире, где технологии становятся неотъемлемой частью нашей реальности.