NVIDIA установила шесть новых рекордов по скорости вычислений в задачах, связанных с ИИ, с выходом первого в индустрии широкого набора бенчмарков для задач искусственного интеллекта.

Получивший поддержку Google, Intel, Baidu, NVIDIA и десятков других лидеров индустрии, новый пакет MLPerf измеряет широкий спектр нагрузок в задачах глубокого обучения. Первый в индустрии пакет с объективной оценкой скорости вычислений для ИИ предназначен для таких областей, как компьютерное зрение, языковой перевод, персональные рекомендации и обучение с подкреплением.

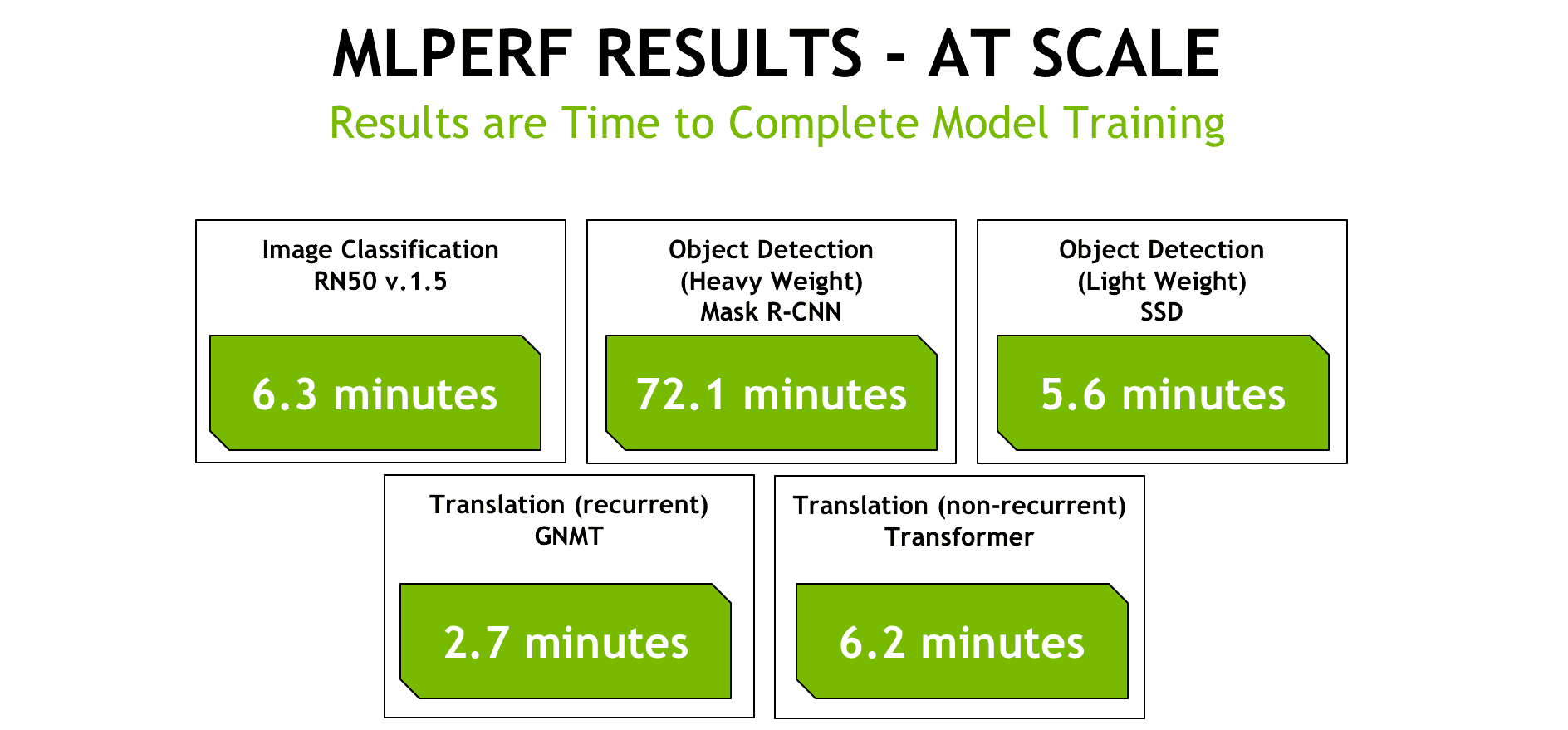

Решения NVIDIA показали наилучшую производительность в шести тестах MLPerf, охватывающих различные нагрузки и масштаб систем: от 16 GPU на узел до 640 GPU на 80 узлов.

Данные 6 категорий включают классификацию изображений, сегментацию объектов, распознавание объектов, нерекуррентный перевод, рекуррентный перевод и системы рекомендаций. NVIDIA не предоставила результаты для седьмой категории обучения с подкреплением, так как в этой категории еще не используются преимущества GPU-ускорения.

Ключевым бенчмарком, в котором технологии NVIDIA показали особенно хороший результат, стала категория языкового перевода – на обучение нейросети Transformer ушло всего за 6.2 минуты. Подробнее о результатах данных шести категорий смотрите на странице сайта NVIDIA для разработчиков.

Инженеры NVIDIA получили данные результаты на системах NVIDIA DGX, включая NVIDIA DGX-2, самой мощной системе для задач ИИ, которая основана на 16 соединенных между собой GPU V100 с тензорными ядрами.

NVIDIA – это единственная компания, отличившаяся сразу в шести категориях и продемонстрировавшая универсальность графических ускорителей V100 с тензорными ядрами в широком спектре задач для ИИ.

“Новые бенчмарки MLPerf демонстрируют несравненную производительность и универсальность GPU NVIDIA с тензорными ядрами, — говорит Ян Бак (Ian Buck), вице-президент и директор NVIDIA по решениям для ускоренных вычислений. – GPU с тензорными ядрами – это решения, доступные во всех регионах у всех провайдеров облачных сервисов и производителей систем; они помогают разработчикам во всем мире и дальше развивать ИИ”.

Для современных ИИ-вычислений требуется комплекс инноваций

Для высокой производительности в сложных и разнообразных вычислительных задачах нужны не только хорошие чипы. Ускоренные вычисления зависят не только от возможностей ускорителя. Требуется целый комплекс усилий.

Платформа NVIDIA включает тензорные ядра NVIDIA, NVLink, NVSwitch, системы DGX, CUDA, cuDNN, NCCL, оптимизированные контейнеры фреймворков глубокого обучения и наборы программных инструментов NVIDIA.

Вычислительная платформа для ИИ NVIDIA является самой доступной, как с точки зрения доступности, так и сточки зрения цены.

Мощь GPU с тензорными ядрами доступна не только в облаках и дата-центрах, но и в настольных ПК на базе видеокарт NVIDIA TITAN RTX по цене всего 2500 долларов США. При условии использования карты более 3х лет, стоимость вычислений составляет всего несколько центов в час.

Программные стеки регулярно обновляются в репозитарии NVIDIA GPU Cloud (NGC).

Рекордная производительность NVIDIA теперь доступна в NGC

Программные инновации и оптимизации, позволившие NVIDIA показать высокие результаты в MLPerf, доступны бесплатно в новых контейнерах глубокого обучения NGC. Их можно загрузить из репозитария NGC.

Контейнеры включают полный программный стек и ведущие фреймворки для ИИ, оптимизированные NVIDIA. Релиз 18.11 контейнеров глубокого обучения NGC включает то же программное обеспечение, которое позволило получить высокие результаты MLPerf.

Разработчики могут применять их везде, на всех стадиях разработки:

- Специалистам по работе с данными контейнеры позволяют проводить передовые исследования с помощью GPU NVIDIA TITAN RTX.

- Небольшие коллективы могут использовать те же самые контейнеры NVIDIA DGX Station.

- Большие компании с помощью контейнеров ускоряют применение ИИ к корпоративным данным в облаке с помощью инстансов, ускоренных NVIDIA GPU, от Alibaba Cloud, AWS, Baidu Cloud, Google Cloud Platform, IBM Cloud, Microsoft Azure, Oracle Cloud Infrastructure и Tencent Cloud.

- Организациям, локально разворачивающим ИИ-инфраструктуру, внедрить ИИ помогут системы NVIDIA DGX и NGC-Ready от Atos, Cisco, Cray, Dell EMC, HP, HPE, Inspur, Lenovo, Sugon и Supermicro.

Чтобы начать работу над ИИ-проектом или запустить собственный бенчмарк MLPerf, загрузите контейнеры из репозитария NGC.