ИИ уже сегодня приносит прибыль в триллионы долларов, улучшая личную жизнь и бизнес-процессы. Он увеличивает темпы технологического прогресса и будет продолжать делать это в еще больших масштабах.

Большая часть внимания и капитала направлена на очень немногие компании, такие как OpenAI, Anthropic и Google. Однако есть предположения, что AGI появится не благодаря одной огромной модели, а скорее благодаря опыту миллиардов агентов ИИ, взаимодействующих с людьми и друг с другом и накапливающих «негласные знания» (как выразился Тайлер Коуэн), навыки и возможности реального мира.

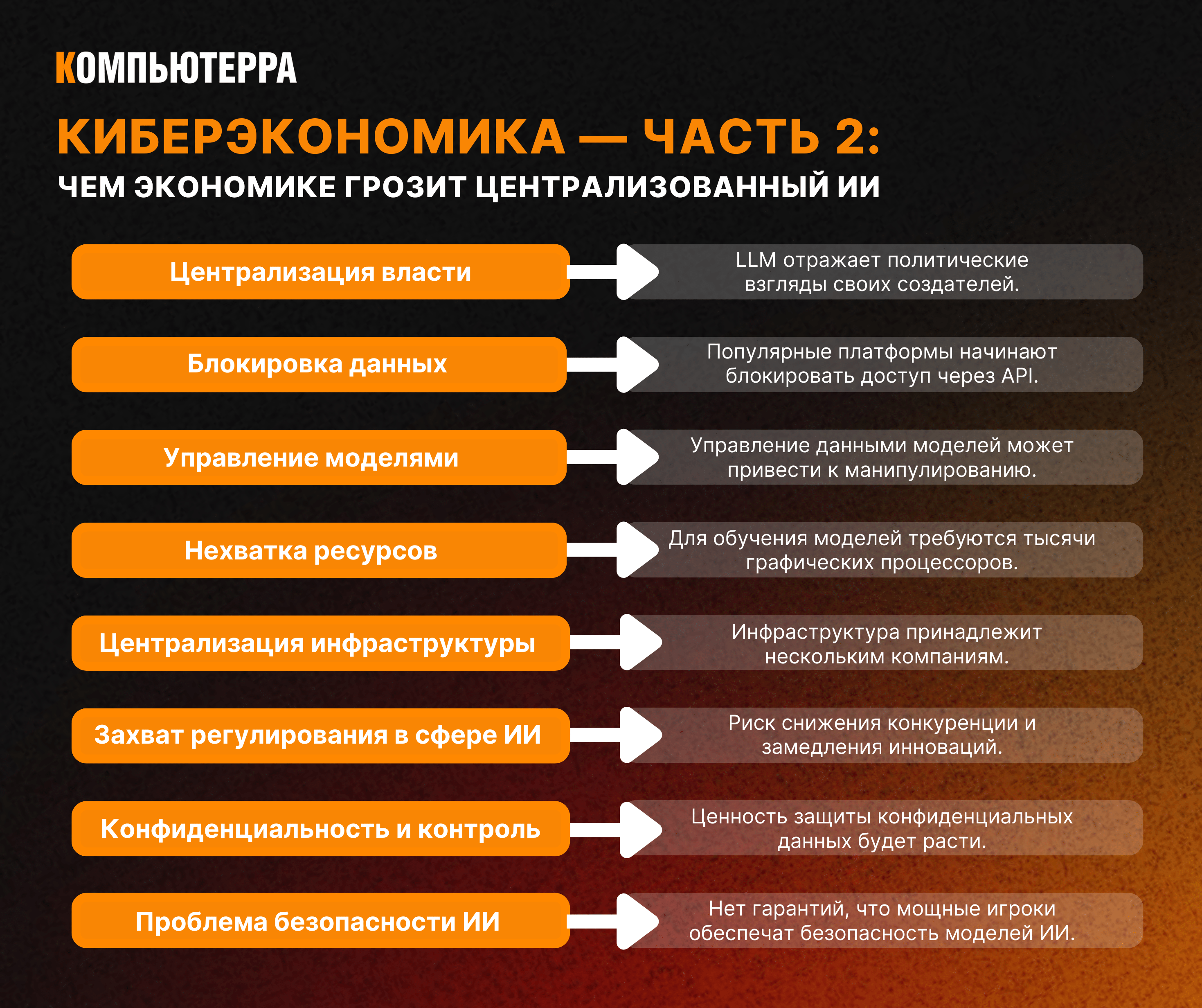

В предыдущей статье изучили, как ИИ-агенты и децентрализация изменят экономику, а в этой рассмотрим риски и потенциальные проблемы, вызванные централизованным характером разработки ИИ.

Централизация власти

Представьте мир, где всего три модели ИИ контролируются тремя корпорациями или правительствами. LLM отражает политические взгляды своих создателей. Даже в открытых моделях мы не знаем, как они обучались и какие у них могут быть предубеждения.

Кроме того, централизованный доступ к API сопряжен с риском простоев или запрета со стороны поставщика API. Это может привести к тому, что бизнес или сервис, от которого вы зависите, окажется недоступным в самый неподходящий момент.

Централизация инфраструктуры

Сегодня инфраструктура, необходимая для создания моделей и приложений ИИ, находится в руках очень немногих специалистов. Цепочка поставок чипов для ИИ контролируется несколькими компаниями. Обучающие данные принадлежат IT-гигантам.

Блокировка данных

Популярные централизованные платформы с пользовательским контентом, такие как Reddit и Twitter, начинают блокировать доступ к пользовательским данным через API. Несмотря на то что контент создается и принадлежит пользователям, платформы решают, кто и как может получить к нему доступ.

Регулирование

Захват регулирования в сфере ИИ создает риск снижения конкуренции и замедления инноваций. С одной стороны, корпорации руководствуются необходимостью максимизировать прибыль акционеров. С другой стороны, регуляторы слишком медленно реагируют и часто отстают от реального развития технологий на многие годы. В условиях постоянно ускоряющегося технологического прогресса традиционные подходы к регулированию просто не успевают за ним. Один крупный субъект не в состоянии адекватно создать условия для прогресса и самоорганизации рынка.

Управление моделями

В большинстве современных моделей очень мало людей решают, что попадает в обучающий набор для нее (следовательно, чему она на самом деле учится). Те же люди решают, что модели разрешено или не разрешено говорить. Это может привести к идеологическому манипулированию.

Конфиденциальность и контроль

Поскольку люди доверяют искусственному интеллекту все больше конфиденциальных данных о себе и своем бизнесе, они не хотят, чтобы все эти данные оказались в едином центре обработки данных. ИИ-друг, тренер, врач и бухгалтер в совокупности будут знать вас лучше, чем кто-либо другой. Поэтому ценность защиты этих данных будет только расти.

Ресурсы и темпы инноваций

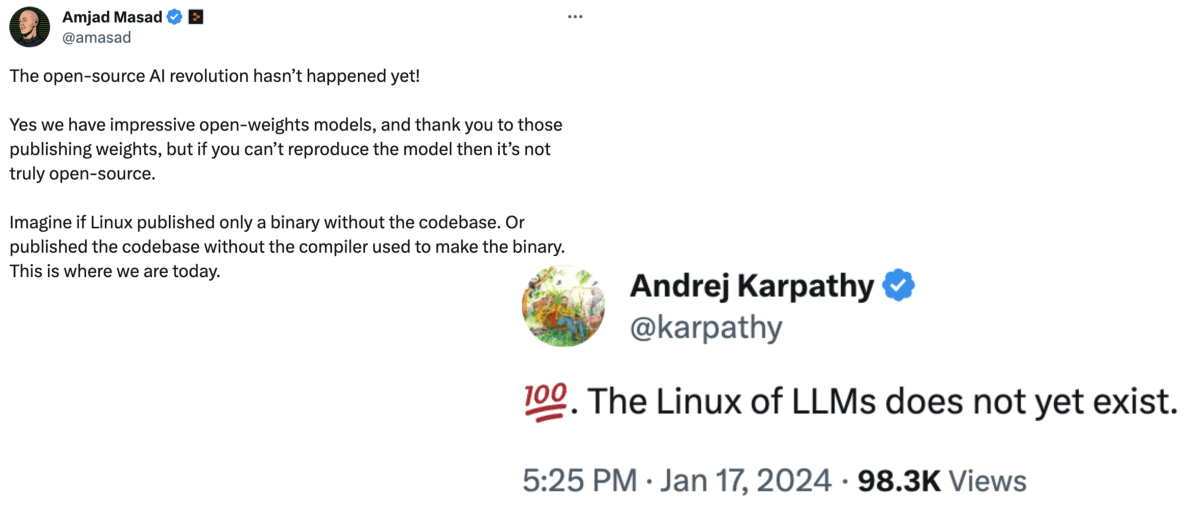

Открытый исходный код, свободный от корпоративного или государственного контроля, стимулировал значительные технические инновации в течение последних нескольких десятилетий. Однако разработка ИИ требует значительных капиталовложений. Для обучения моделей с 200 млрд параметров требуются тысячи графических процессоров.

Одноранговая экономика (P2P) предлагает решение, ускоряя конкуренцию и проверку идей. На открытом рынке и в формате открытого исходного кода люди могут быстрее формулировать и проверять гипотезы, получать обратную связь и доступ к ресурсам для наиболее перспективных идей.

Проблема безопасности ИИ

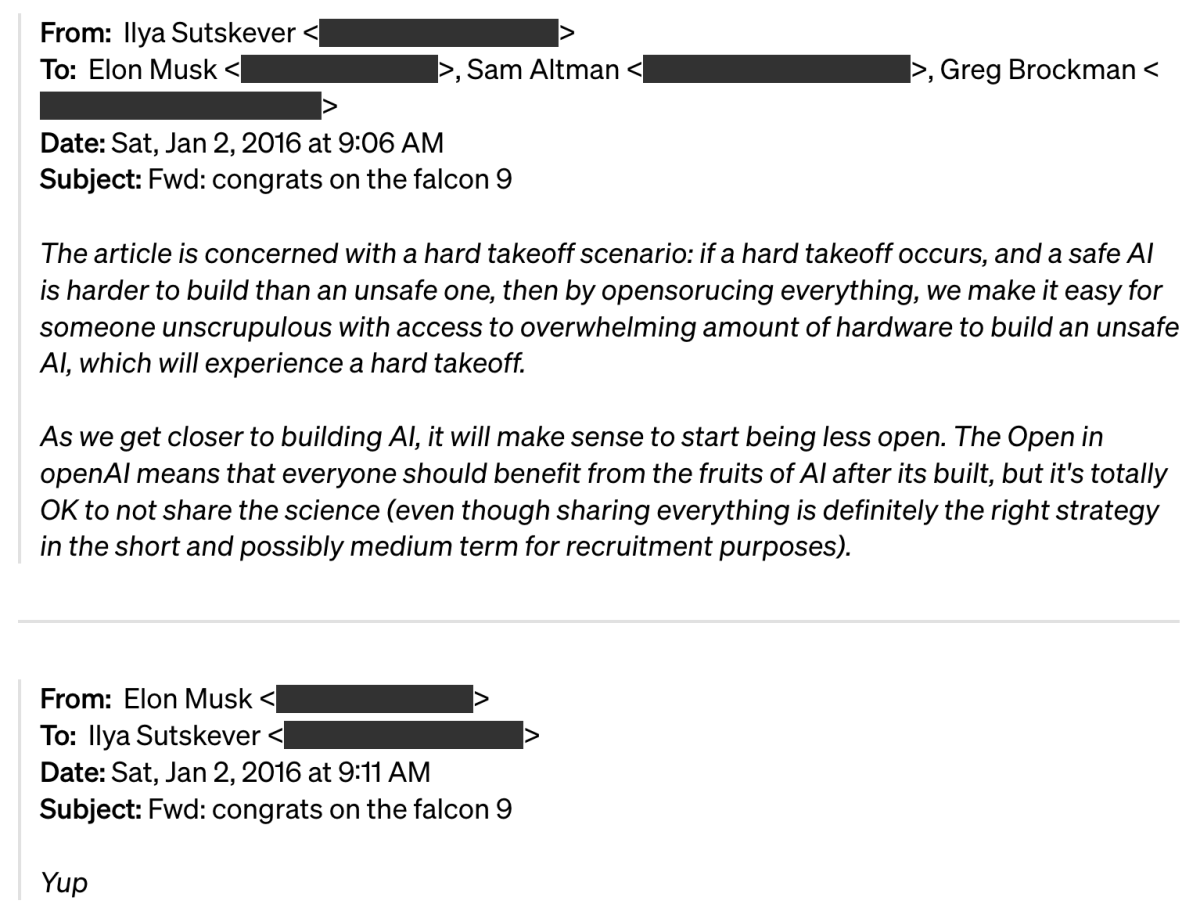

Конфликт между Илоном Маском и OpenAI пролил свет на мысли основателей компании о безопасности ИИ и проблеме ИИ с открытым исходным кодом.

Неофициальным девизом Google на протяжении нескольких десятилетий была фраза «Не будь злом». Этот моральный принцип предполагает, что внутренние команды будут принимать правильные решения, но по мере того, как стартап превращался в корпорацию с триллионным оборотом, он терялся в непомерной бюрократии и несогласованных стимулах заинтересованных сторон.

В отличие от этого, биткоин стал пионером подхода «Не может быть злом». Это означает, что любой человек может свободно совершать любые транзакции в сети, но правила консенсуса запретят любые незаконные или злонамеренные действия без какого-либо централизованного контроля или бюрократических процедур.

Проблема безопасности ИИ остается нерешенной. Нет гарантий, что мощные централизованные игроки (корпорации или государства) сделают все возможное для обеспечения безопасности своих самых мощных моделей ИИ. На самом деле у них есть серьезные стимулы сохранить эти модели для себя, чтобы победить конкурентов. Но и в open-source могут быть разработчики, которые попытаются использовать мощный ИИ не по назначению или злоупотреблять им.

По сути, это проблема отрицательных внешних эффектов, также известная как проблема Молоха. Частично ее можно решить с помощью жесткого регулирования и контроля, но за счет всех рисков, описанных выше. Но гораздо более надежным подходом будет создание новых механизмов координации, использующих децентрализованную репутацию, криптографию и парадигму без доверия. Кроме того, важна радикальная прозрачность вместо лоббизма за закрытыми дверями.

ЧИТАТЬ ЕЩЕ:

Киберэкономика — часть 1: как ИИ-агенты и децентрализация изменят экономику

Киберэкономика — часть 3: как построить децентрализованную сеть ИИ-агентов