Исследователи из Чикагского университета представили программное обеспечение для защиты изображений, которые пользователи загружают в интернет.

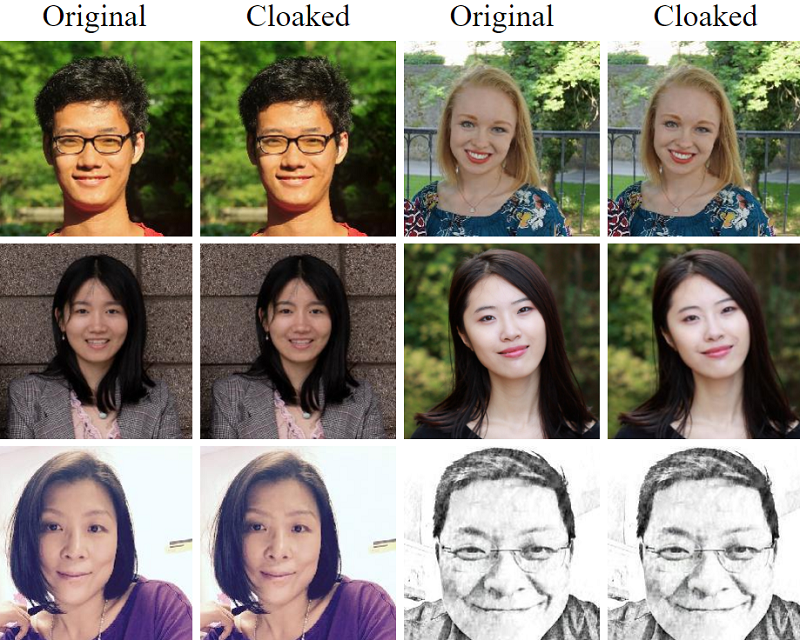

Инструмент под названием Fawkes пользуется тем, что в модели машинного обучения нужно загружать множество изображений, чтобы идентифицировать определенные отличительные черты человека. Программа вносит в изображения небольшие изменения на уровне пикселей, которые невидимы для человеческого глаза, но могут эффективно «скрыть» лицо, чтобы модели машинного обучения не могли с точностью определить человека.

Например, исследователи замаскировали изображения актрисы Гвинет Пэлтроу, используя другие изображения с лицом актера Патрика Демпси. Фотографии обменялись пикселями, что практически не изменило изображения. Однако это помешало алгоритмам машинного обучения (GAN) создать модель, которая была бы способна распознать внешность актрисы на фотографиях.

При этом инструмент смог обмануть системы распознавания лиц от Facebook, Microsoft, Amazon и китайской технологической компании Megvii.

Исследователи отмечают, что программа Fawkes работает не идеально — инструмент ничего не может сделать с моделями, уже построенными на основе данных, которые не были изменены. Например, тех, которые уже используются такими компаниями, как Clearview AI, а также правоохранительными органами.

Разработчики считают, что успех инструмента будет зависеть от того, получит ли Fawkes широкое распространение среди людей, загружающих свои фотографии в интернет. О работе исследователи рассказывают в видео ниже (на английском языке).

Генеральный директор Clearview AI Хоан Тон-Тат сказал, что программа, похоже, не работает против системы распознавания лиц компании. Также директор отметил, что с учетом огромного количества немодифицированных изображений, доступных онлайн, «почти наверняка уже слишком поздно совершенствовать такую технологию, как Fawkes, и пытаться распространять ее».

Система Clearview AI собирала фотографии людей из Twitter, Facebook, Google и YouTube для создания базы данных распознавания лиц. Компания не запрашивала разрешения ни у кого из пользователей этих сервисов и, как утверждается, имеет слабые методы обеспечения безопасности.

Профессор Бен Чжао, который координировал разработку Fawkes, говорит, что такие сервисы, как Clearview AI, все еще далеки от того, чтобы иметь полный набор изображений для всех пользователей интернета. Чжао также отметил, что Fawkes основан на атаке отравления, которая предназначена для постепенного повреждения моделей распознавания лиц по мере того, как процент замаскированных изображений со временем увеличивается.

На момент написания статьи Fawkes доступен на веб-сайте проекта и уже был загружен более 100 000 раз. Исследователи надеются, что Facebook и другие компании, приобретут или разработают аналогичные инструменты для защиты пользователей от других сервисов, которые пытаются использовать изображения, загруженные в социальную сеть.